この記事は、インテル® コミュニティーのブログに公開されている「Innovation 2022: End-to-End AI Pipeline Development and Deployment」の日本語参考訳です。原文は更新される可能性があります。原文と翻訳文の内容が異なる場合は原文を優先してください。

AI パイプラインの “トライアスロン” 構想

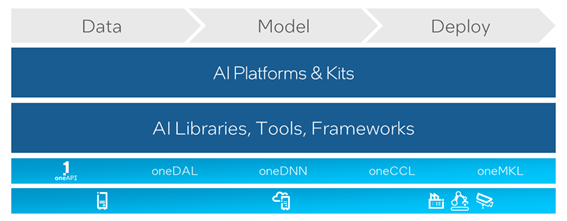

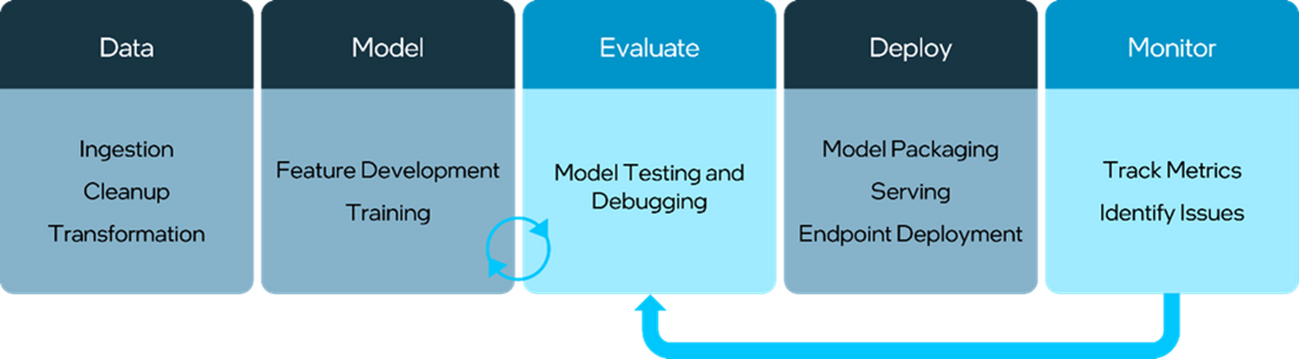

インテルの Vrushabh Sanghavi は、まずエンドツーエンドの AI パイプラインをトライアスロンに例えて、3 つのフェーズすべてで速くなければならない、と述べました。AI パイプラインの場合、それらのフェーズは以下のとおりです。

- データ: データの取り込み、クリーンアップ、変換、操作

- モデル: 機械学習または深層学習モデルのトレーニング、結果の評価、反復、そして推論への使用

- デプロイ: モデルのパッケージング、サービング、エンドポイントのデプロイ

インテルの AI ソフトウェア・スイートは、このエンドツーエンドのパイプラインにまたがり最適化します。

oneAPI Deep Neural Network Library (oneDNN) や oneAPI Data Analytics Library (oneDAL) などのライブラリーは、一般的なオープン・ソース・ツールやフレームワークに適用されるソフトウェアの最適化によって、ハードウェアの潜在能力を引き出します。モデルやワークフローの効率を向上させる技術には、インテル® Neural Compressor を使用したモデル圧縮、SigOpt によって自動化されたハイパーパラメーター・チューニングとインスタンス最適化、または転移学習が含まれます。

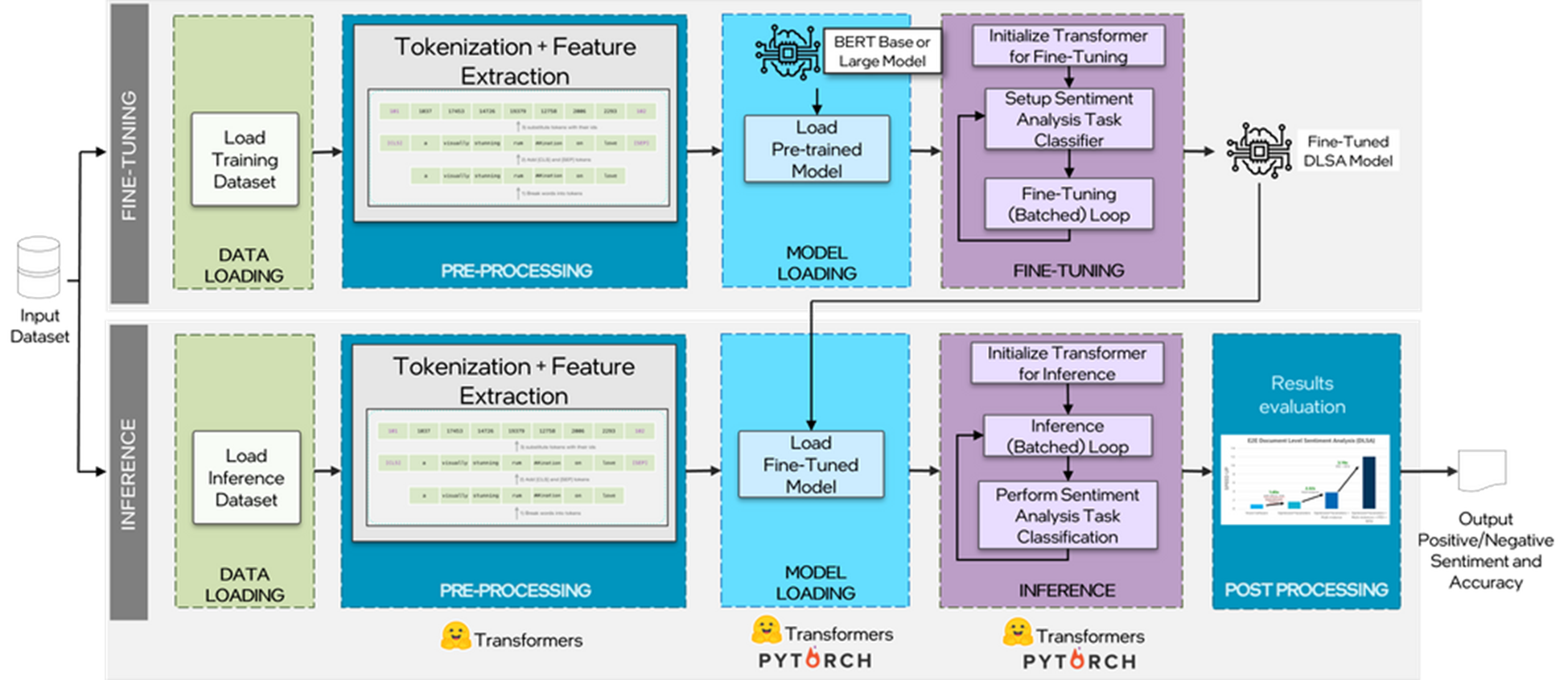

Vrushabh は、XGBoost による機械学習と、Hugging Face* Transformers API を使用した自然言語処理の文書レベル感情分析 (DLSA) のための深層学習のユースケースにおいて、この一連の最適化の効果を示しました。

Hugging Face* Transformers の使用は、強固なエコシステムの必要性を浮き彫りにしています。1 つのベンダーが、異なる要件を持つ産業分野での生産利用に必要なすべてのものを提供できるわけではありません。さまざまなベンダーによって、既存のパイプラインやコンテナにプラグインする必要がある独自の専門性が提供されます。このセッションの残りの部分では、AI エコシステムにおける 2 つの興味深いソリューションが紹介されました。

Ai-Optimization-as-a-Service*

Zeblok Computational 社は AI パイプライン・ツールやアセットの互換性を容易にすることを支援しています。Zeblok 社の創業者兼 CEO である Mouli Narayanan 氏は、2023年初頭に開始する新しいソリューションである Ai-Optimization-as-a-Service* を発表しました。同社の Ai-MicroCloud* 技術に基づいて構築されたこのエンタープライズ向けサービスは、基盤となるハードウェアに関係なく、パブリックおよびプライベート・クラウド・プラットフォームで AI パイプラインを実行します。これにより、企業はプロジェクトのニーズに適応し、このエンドツーエンドの AI ソフトウェア・スイートは、必要な計算プラットフォームやデータ・プラットフォームにコンテナでより簡単にデプロイできます。Vrushabh が提示した DLSA の例を用いて、コンテナを動的に構成し、AWS* とインテル® Developer Cloud の両方にデプロイすることで、このすべてがどのように機能するかを示しました。エンドツーエンドのパイプライン全体におけるさまざまなツールの量と選択を考慮すると、これによりチームの時間とフラストレーションを大幅に削減することができます。

AI 品質

TruEra 社は、AI 業界のベテランによって設立された会社で、生産中の AI モデルが優れたパフォーマンスを続け、ビジネス価値を提供し、公正かつ非差別的であることを保証することを使命としています。そのためには、「トライアスロン」に次の 2 つのフェーズを加える必要があります。

モデル評価:構築直後、デプロイ前にモデルの品質をテストします。

生産監視:モデルが正常に稼働し続けるかどうか確認します。

TruEra 社は、それぞれのタスクに対して、互いに連携する製品を提供しています。例えば、開発テストやデバッグのための TruEra Diagnostics* は、モデルが本番稼動した後に追跡すべき問題の種類を特定するのにも役立ちます。また、TruEra Monitoring* は、モデルのドリフトや品質問題の原因となる機能を特定するための根本原因解析に役立ち、迅速に再トレーニングと再デプロイを行うことができます。

これらのステップは、特に医療、銀行、保険、製造などの業界において、本番環境でのデプロイに欠かせないものです。TruEra 社の共同設立者であり、社長兼チーフ・サイエンティストの Anupam Datta 氏は、国勢調査を例にして説明しました。この例は、国勢調査のデータセットから所得を予測しようとするものです。この場合、モデルはツールの「公平性テスト」に失敗し、ツールはどの機能がその失敗に最も貢献したかを示しました。

国勢調査のデータセットでは、PERNUM (世帯から聴取した人の番号) のような無害そうな特徴を見落としがちですが、その効果を見れば、それがどのように偏った結果をもたらすかが理解できます。Anupam 氏は、モデルにおける潜在的なバイアスの実例をいくつか挙げ、このツールがどのようにそれを特定するのに役立つかを説明しました。しかし、彼は、モデルが本当に偏っているのかどうか、そしてそれをどのように修正するのか、という人間の意思決定の重要性を強調しました。このようなツールは、潜在的な問題や影響を特定するのに役立つため、AI の広範な展開の鍵となるものです。これでも人間の意思決定が必要ですが、計算機資源を使って複雑な分析を行うことで、人間は必要なところに集中できるようになります。

プロダクションへの準備

OneAPI を搭載したインテルのソフトウェアは、コアツールとフレームワークを高速化し、作業に最適なハードウェア・アーキテクチャーで実行する柔軟性を提供します。Zeblok 社の Ai-Optimization-as-a-Service* は、プロジェクトに必要なプラットフォームにコンテナ化されたワークフローを簡単に展開できるようにします。TruEra Diagnostic* と TruEra Monitoring* は、AI に対する信頼を築き、その品質を生産ライフサイクルにわたって維持するために必要なツールでワークフローを満たします。

AI パイプラインを最適化する方法の詳細については、インテルの AI および機械学習の開発ツールおよびリソース (英語) をご覧ください。

当ブログ記事で紹介している oneDNN や oneDAL はインテル® oneAPI ベース・ツールキットに含まれています。