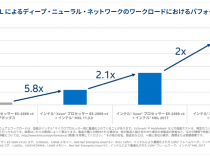

マシンラーニング (機械学習) の中でもディープラーニング (深層学習) は、特に注目され様々な分野で応用が進められています。ディープラーニングでは学習精度の向上と引き換えに膨大な量の計算を行うため、計算時間を短くする手段として一般的に GPU を使用して処理されますが、インテル®ソフトウェア開発製品を使用することでプロセッサーだけでも十分なスピードで計算することができます。

簡単に高速なマシンラーニングを試してみませんか?

主要フレームワークと対応状況

ディープラーニング向けには多様なフレームワークが提供されています。

インテル社は、ディープラーニングのコミュニティーと協力して、インテル® アーキテクチャー上で演算パフォーマンスが向上するように多くのフレームワークを最適化しています。

フレームワーク |

概要 |

推奨 OS |

使用言語 |

推奨されるインテル® ソフトウェア開発製品 |

Caffe* |

カリフォルニア大学バークレー校の研究センター Berkeley Vision and Learning Center (BVLC) が開発した、画像認識に強いフレームワーク。 詳細はこちら。 |

Windows* Ubuntu* RHEL*/CentOS*/Fedora* OS X* |

C/C++ Python* |

インテル® Caffe インテル® MKL インテル® MKL-DNN インテル® VTune™ Amplifier |

TensorFlow* |

Google が開発したフレームワーク。Google が提供するサービスの写真検索や、音声認識技術でも実際に使われている。 | Ubuntu* CentOS* |

Python* | インテル® ディストリビューション for Python* インテル® MKL インテル® VTune™ Amplifier |

Chainer* |

Preferred Networks 社が開発した、国産のフレームワーク。 | Windows* Linux* (Ubuntu* 推奨) OS X* |

Python* C++ |

インテル® ディストリビューション for Python* インテル® MKL インテル® VTune™ Amplifier |

Theano* |

モントリオール大学の LISA Lab が中心になって開発した、Python* の数値計算ライブラリー。多次元配列など数式の定義、最適化、評価を行え、ディープラーニングだけでなく、様々な数値計算で適用可能。 詳細はこちら (英語)。 |

Windows* Linux* OS X* |

Python* | インテル® ディストリビューション for Python* インテル® MKL インテル® VTune™ Amplifier |

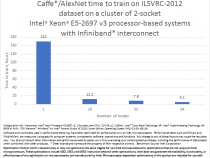

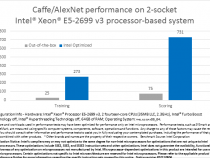

Caffe*

CPU 上での使用向けに最適化したディストリビューション "インテル® Distribution of Caffe*" (インテル® Caffe*) が配布されています。 特に近年にリリースされたインテル® Xeon® プロセッサー搭載のサーバーでの高速化が期待されています。

対応するインテル® ソフトウェア開発製品

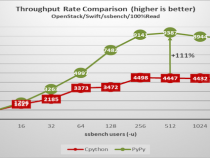

インテル® ディストリビューション for Python*

Python* アプリケーションのパフォーマンスを向上する統合パッケージ。Python* 実行環境や NumPy* や SciPy* などのライブラリーとあわせて、インテルの最適化されたライブラリー群を一括でインストールできます。

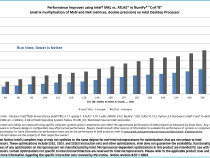

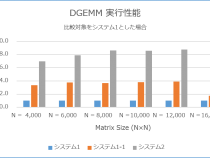

インテル® Python* から NumPy* や SciPy* を使用すると自動的にインテル® MKL やインテル® DAAL が呼び出されるため、パフォーマンスを大幅に向上することができます。

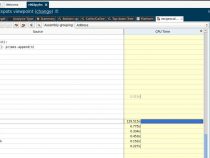

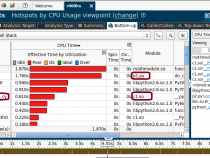

インテル® VTune™ Amplifier

多くの CPU 時間を費やしているモジュール/プロセス (hotspot) の特定を支援する、パフォーマンスおよび電力プロファイラー。

Python*、C、C++、Fortran、Go™、Java* に加えて、言語が混在したコードを解析することができます。本ツールを使用することで、Python* スクリプトを解析してアプリケーションで時間が費やされている場所を正確に特定することができます。

インテル® DAAL

一般的に利用されるデータ分析アルゴリズムのビルディング・ブロックを提供する C++、Java*、Python* 向けライブラリー。

データ解析の全段階 (前処理、変換、解析、モデリング、意思決定) に対応したアルゴリズムは、インテル® アーキテクチャー向けに最適化されています。ディープラーニング向けのニューラル・ネットワークや、ナイーブベイズ分類器等のアルゴリズムにも対応しており、インテル® DAAL を使用することで、ビッグデータ解析、ディープラーニング用アプリケーションの開発時間を短縮することができます。

インテル® MKL

インテル® プロセッサー向けに最適化済みの数値演算ライブラリー。高度にベクトル化およびスレッド化された線形代数、高速フーリエ変換 (FFT)、ベクトル数学関数、そして統計関数を含みます。また、畳み込み、活性化、正規化、プーリング関数を含む、DNN (ディープ・ニューラル・ネットワーク) プリミティブを提供し、ディープラーニングをサポートします。